Introducción

La computación cuántica suele presentarse como una tecnología casi mágica: ordenadores capaces de hacerlo todo a la vez, de romper cualquier cifrado o de resolver en segundos problemas imposibles para la informática clásica. Sin embargo, detrás de ese discurso llamativo hay una realidad mucho más interesante… y mucho más sutil.

En el centro de la computación cuántica no hay algoritmos misteriosos ni máquinas futuristas, sino una pieza básica: el qubit. Comprender qué es (y, sobre todo, qué no es) un qubit resulta esencial para entender qué puede ofrecer realmente esta nueva forma de computar y cuáles son sus límites.

Este artículo no pretende entrar en matemáticas ni en detalles técnicos complejos. El objetivo es más sencillo y, a la vez, más importante: interiorizar el concepto. Veremos por qué un qubit no es un bit «mejor», en qué se diferencia de la información clásica, qué ocurre antes y después de medir, y cuáles son los errores más comunes al intentar entenderlo.

Si al terminar la lectura te queda clara una idea —que la computación cuántica no trata de resultados mágicos, sino de estados y probabilidades cuidadosamente controladas—, entonces el objetivo estará cumplido.

Recordemos primero qué es un bit

Antes de hablar de qubits y computación cuántica, conviene dar un paso atrás y recordar algo fundamental: qué es exactamente un bit. Aunque el término nos resulte familiar, entender bien su papel ayuda mucho a apreciar por qué la computación cuántica es tan diferente.

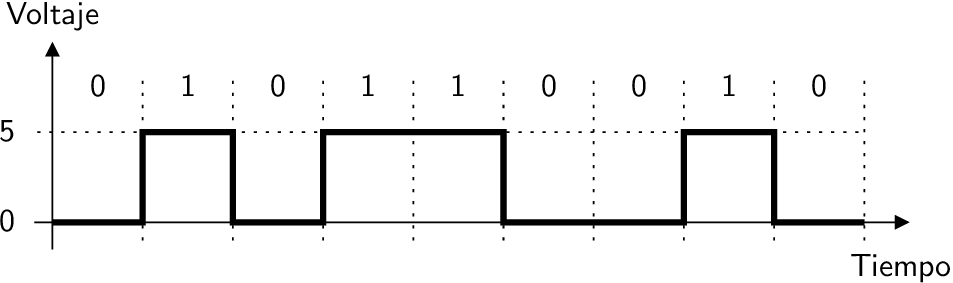

Un bit es la unidad más pequeña de información en la informática clásica. Su nombre viene de binary digit (dígito binario) y su comportamiento es extremadamente sencillo: solo puede tomar uno de dos valores posibles, normalmente representados como 0 y 1.

Esta idea de dos estados puede visualizarse de muchas maneras. Un interruptor puede estar encendido o apagado. Una bombilla puede estar iluminada o apagada. Una puerta puede estar abierta o cerrada. En todos los casos, no hay ambigüedad: el sistema está en un estado o en el otro.

En un ordenador clásico, los bits se implementan físicamente mediante dispositivos electrónicos que trabajan con dos niveles bien definidos, por ejemplo presencia o ausencia de corriente eléctrica. Gracias a esta separación clara entre estados, los ordenadores pueden realizar cálculos de forma fiable y repetible.

Lo importante es que, en todo momento, cada bit tiene un valor perfectamente definido. Incluso aunque no lo estemos observando, el bit sigue siendo un 0 o un 1. No hay incertidumbre ni probabilidades asociadas a su estado. Si leemos el mismo bit varias veces seguidas, obtendremos siempre el mismo resultado mientras nada lo modifique.

A partir de esta unidad tan simple se construye todo lo demás. Combinando muchos bits se pueden representar números, texto, imágenes, sonidos o vídeos. También se pueden realizar operaciones lógicas y matemáticas siguiendo reglas muy precisas. Toda la potencia de la informática clásica surge de manipular enormes cantidades de bits, pero cada uno de ellos sigue comportándose de manera totalmente determinista.

Este comportamiento tan bien definido es justo lo que contrasta con lo que ocurre en la computación cuántica. Para entender por qué el qubit no se comporta igual, primero había que dejar claro este punto:

un bit siempre es 0 o 1, sin excepciones.

Con esta base clara, ya estamos en condiciones de ver qué cambia cuando pasamos del bit clásico al qubit cuántico… y por qué ese cambio es tan profundo.

Entonces, ¿qué es un qubit?

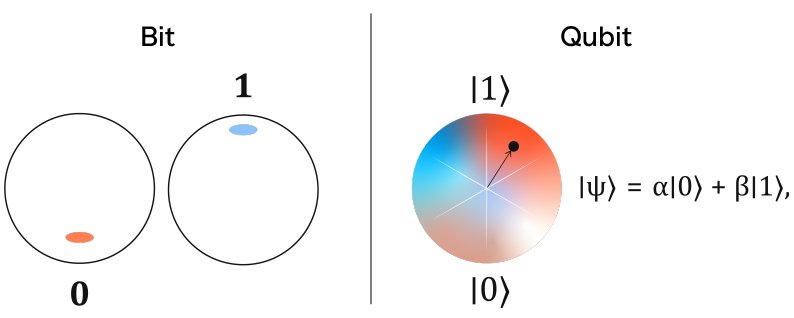

Si el bit es la unidad básica de la informática clásica, el qubit es la unidad básica de la computación cuántica. Hasta aquí, la analogía es sencilla. Lo que resulta menos intuitivo es entender cómo se comporta.

Un qubit es un sistema físico que obedece las leyes de la mecánica cuántica y que se utiliza para codificar información. Puede implementarse de muchas formas distintas: átomos, iones atrapados, circuitos superconductores o fotones, entre otros. Pero, independientemente de su implementación física, todos los qubits comparten una característica esencial: su estado no siempre está definido como 0 o como 1.

A diferencia de un bit clásico, que siempre tiene un valor fijo, un qubit puede encontrarse en un estado que describe una combinación de posibilidades. Esto es lo que se conoce como superposición. Antes de medirlo, el qubit no «elige» un valor concreto; su estado contiene información sobre la probabilidad de obtener un 0 o un 1 cuando finalmente lo observamos.

Aquí conviene insistir en una idea importante. Decir que un qubit «es 0 y 1 a la vez» es una simplificación que puede llevar a errores. No significa que el qubit tenga dos valores simultáneos, como si guardara dos bits en uno. Significa que su estado no puede describirse con un único valor clásico hasta que se realiza una medición.

Cuando medimos un qubit, el resultado siempre es claro y clásico: obtenemos un 0 o un 1. No aparece ningún valor extraño ni intermedio. La diferencia con un bit no está en el resultado de la medida, sino en todo lo que ocurre antes de medir.

Durante ese «antes», el qubit puede evolucionar y ser manipulado mediante operaciones cuánticas que modifican sus probabilidades. Estas operaciones no obligan al qubit a decidir si es 0 o 1, sino que transforman su estado de forma continua, siguiendo reglas muy precisas de la física cuántica.

Una forma intuitiva de pensarlo es imaginar que el qubit no representa un valor, sino un estado. Y ese estado puede cambiar, combinarse y correlacionarse con otros qubits, incluso aunque al final solo podamos leer un 0 o un 1.

En resumen, un qubit es la unidad mínima de información cuántica, pero no funciona como un bit con esteroides. Es un sistema que permite trabajar con posibilidades y probabilidades antes de la observación, y es precisamente esa diferencia la que abre la puerta a una forma completamente nueva de computar.

La idea clave: antes y después de medir

Para entender qué hace realmente especial a un qubit, hay una idea que conviene tener muy clara desde el principio: no se comporta igual antes y después de ser medido. Esta diferencia, que no existe en la computación clásica, es fundamental para comprender la computación cuántica sin caer en mitos.

En un ordenador clásico, medir no cambia nada esencial. Si leemos el valor de un bit, simplemente lo consultamos: el bit ya era 0 o 1 antes de mirarlo y seguirá siéndolo después. La medición no altera el estado del sistema, solo nos informa de él.

Con un qubit ocurre algo muy distinto.

Antes de medir, el qubit se encuentra en un estado cuántico. Ese estado no corresponde a un valor concreto, sino que describe un conjunto de posibilidades. No tiene sentido preguntar si el qubit es 0 o 1, porque esa pregunta todavía no está bien formulada en términos clásicos. Lo único que podemos afirmar es con qué probabilidad obtendremos cada resultado si realizamos una medición.

Cuando medimos un qubit, ocurre un cambio radical: el estado cuántico desaparece y el sistema pasa a un estado clásico. El resultado es siempre claro y definido: 0 o 1. A partir de ese momento, el qubit ya se comporta como un bit convencional.

Esta transición, de un estado cuántico lleno de posibilidades a un valor clásico concreto, marca la frontera entre el «antes» y el «después» de medir. Y lo más importante es que no hay marcha atrás: una vez medido, el qubit ha perdido la información cuántica que tenía antes.

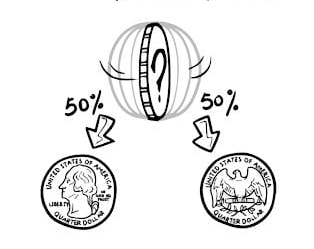

Una analogía útil para entender esta diferencia es la de una moneda girando en el aire. Mientras gira, no podemos decir que sea cara o cruz. Solo cuando cae sobre la mesa obtenemos un resultado definido. De forma similar, antes de medir un qubit no tiene un valor fijo, y la medición fuerza al sistema a adoptar uno.

Eso sí, conviene no llevar la analogía demasiado lejos. La moneda es impredecible por razones prácticas (no conocemos todas las fuerzas que actúan sobre ella), mientras que el qubit evoluciona siguiendo leyes muy precisas. El resultado puede parecer aleatorio, pero las probabilidades están determinadas por cómo se ha preparado y manipulado el qubit.

Aquí está la clave de la computación cuántica: los algoritmos cuánticos no buscan obtener directamente un resultado «mágico» al medir, sino diseñar cuidadosamente la evolución del sistema antes de la medición para aumentar la probabilidad de obtener el resultado deseado.

En otras palabras, el valor final importa, pero el verdadero trabajo se hace antes de medir. Entender esta diferencia es esencial para comprender por qué la computación cuántica no consiste en probarlo todo a la vez, sino en aprovechar una forma distinta, y muy precisa, de tratar la información.

Cómo se describe un qubit (sin entrar en matemáticas)

Hasta ahora hemos hablado de qubits como sistemas que no tienen un valor fijo antes de ser medidos, sino que contienen varias posibilidades. Pero entonces surge una pregunta: si no decimos que un qubit es 0 o 1, ¿cómo describimos su estado?

La respuesta corta es sencilla: describiéndolo en términos de probabilidades.

Un qubit se caracteriza por la probabilidad de obtener un 0 y la probabilidad de obtener un 1 cuando lo medimos. Estas probabilidades no aparecen por azar ni se asignan de forma arbitraria. Dependen de cómo se haya preparado el qubit y de las operaciones que se hayan aplicado sobre él.

Por ejemplo, un qubit puede prepararse de tal forma que, al medirlo, tenga la misma probabilidad de dar 0 que de dar 1. También puede prepararse para que casi siempre dé 0 y solo ocasionalmente dé 1, o al revés. Todas estas situaciones describen estados distintos, aunque el resultado final siga siendo siempre un 0 o un 1.

Aquí hay una idea importante que conviene subrayar: el estado del qubit no es el resultado, sino la información que determina esas probabilidades. Dos qubits pueden dar el mismo resultado al medirlos una vez y, sin embargo, encontrarse en estados muy diferentes si sus probabilidades no coinciden.

Además, estas probabilidades pueden cambiar de forma controlada. Las operaciones cuánticas actúan sobre el estado del qubit modificando cómo se reparte la probabilidad entre 0 y 1. No fuerzan una decisión inmediata, sino que transforman el estado de manera progresiva, siguiendo reglas bien definidas.

Otra idea clave es que esta forma de describir un qubit solo tiene sentido antes de medir. Una vez que el qubit se mide y obtenemos un resultado, toda esa información probabilística se pierde. El qubit pasa a comportarse como un sistema clásico, igual que un bit convencional.

Dicho de otra forma: mientras no medimos, el qubit se describe por cómo puede comportarse; después de medir, solo podemos decir qué ha ocurrido. La computación cuántica trabaja principalmente en esa fase previa, donde el estado aún contiene toda la información relevante.

Sin necesidad de matemáticas, podemos quedarnos con esta idea: un qubit no se describe por un valor, sino por un estado que determina las probabilidades de los posibles resultados, y ese estado puede manipularse de forma precisa antes de que la medición lo convierta en un simple 0 o 1.

Qué hace especial al qubit

Después de entender qué es un qubit y cómo se describe, puede surgir esta pregunta: Si al final siempre obtenemos un 0 o un 1 al medir, ¿dónde está realmente la diferencia con un bit clásico?

La respuesta está en lo que se puede hacer antes de medir.

Un qubit permite realizar operaciones que no existen en la computación clásica. Estas operaciones no cambian directamente un valor de 0 a 1, sino que transforman el estado del qubit, modificando las probabilidades de los posibles resultados. En lugar de trabajar con valores fijos, se trabaja con estados que pueden evolucionar de manera continua y controlada.

Esto, por sí solo, ya supone una diferencia importante. Pero lo realmente interesante aparece cuando se utilizan varios qubits a la vez.

Cuando dos o más qubits interactúan, sus estados pueden quedar relacionados de una forma muy especial. El estado de cada qubit deja de poder describirse de manera independiente y pasa a formar parte de un estado conjunto. En estas situaciones, medir un qubit puede afectar a las probabilidades de los demás, incluso aunque estén separados físicamente. Este fenómeno se conoce como entrelazamiento.

No hace falta entrar en detalles técnicos para captar la idea general: con qubits, la información no siempre se reparte «por piezas», qubit a qubit, como ocurre con los bits clásicos. En muchos casos, la información relevante está en el conjunto completo del sistema, no en cada elemento por separado.

Gracias a esta forma de trabajar con estados y correlaciones, algunos problemas pueden abordarse de manera distinta a como se harían con un ordenador clásico. No se trata de probar todas las soluciones a la vez ni de obtener respuestas mágicas, sino de diseñar la evolución del sistema para que ciertas respuestas se vuelvan más probables que otras.

Eso sí, conviene ser claros: no todos los problemas se benefician de este enfoque. En muchos casos, un ordenador clásico sigue siendo la mejor herramienta. La computación cuántica no sustituye a la clásica, sino que la complementa en situaciones muy concretas.

En resumen, lo que hace especial al qubit no es que almacene más información ni que produzca resultados imposibles, sino que permite una forma distinta de procesar la información antes de medir. Es en esa fase previa, trabajando con estados y relaciones entre qubits, donde reside el verdadero potencial (y también la dificultad) de la computación cuántica.

Errores comunes al entender el qubit

La computación cuántica suele explicarse con frases llamativas que ayudan a captar la atención, pero que a menudo generan ideas equivocadas. Entender qué no es un qubit es tan importante como entender qué es realmente. Veamos algunos errores frecuentes.

«Un qubit guarda más información que un bit»

Este es uno de los malentendidos más habituales. Cuando medimos un qubit, el resultado es siempre un solo valor: 0 o 1. Exactamente igual que en el caso de un bit clásico. No obtenemos dos bits de información ni una respuesta «hipervitaminada».

La diferencia no está en la cantidad de información que leemos al final, sino en cómo se procesa la información antes de medir. El qubit permite trabajar con estados que contienen probabilidades y relaciones que no existen en la computación clásica, pero esa información no es directamente accesible como datos extra.

«Un qubit prueba todas las opciones a la vez»

A veces se dice que un ordenador cuántico «prueba todas las soluciones simultáneamente». La frase suena impresionante, pero no describe lo que ocurre realmente.

Un qubit no explora todas las posibilidades como si ejecutara muchos cálculos en paralelo. Lo que hace es evolucionar según reglas cuánticas que modifican las probabilidades de los resultados posibles. Si el algoritmo está bien diseñado, la respuesta correcta se vuelve más probable. Si no lo está, la medición puede dar un resultado poco útil.

No hay fuerza bruta cuántica ni atajos mágicos.

«La superposición lo explica todo»

La superposición es una idea importante, pero por sí sola no explica la computación cuántica. Un qubit en superposición, sin más, no ofrece ninguna ventaja práctica. Lo relevante es cómo se combinan varios qubits y cómo se controlan sus interacciones.

Sin operaciones bien diseñadas y sin correlaciones entre qubits, la superposición no aporta nada especial desde el punto de vista computacional.

«Medir es solo leer el valor»

En computación clásica, leer un valor no cambia el sistema. En computación cuántica, medir sí cambia el estado. Pensar que medir un qubit es simplemente «mirar qué hay dentro» conduce a errores conceptuales importantes.

La medición colapsa el estado cuántico y lo convierte en un estado clásico. Por eso no podemos medir un qubit varias veces para «averiguar más cosas». La primera medición ya ha cambiado el sistema.

«La computación cuántica sirve para todo»

Otro error común es pensar que los qubits harán obsoletos a los ordenadores clásicos. No es así. La computación cuántica solo ofrece ventajas en problemas muy concretos y siempre dentro de límites bien definidos.

Para la mayoría de las tareas cotidianas (navegar por internet, escribir documentos, gestionar bases de datos) los bits clásicos siguen siendo la mejor opción.

Entender estos errores ayuda a poner la computación cuántica en su sitio: ni magia, ni solución universal, ni simple evolución de la informática clásica. El qubit es una pieza distinta, con reglas propias, y comprender bien esas reglas es el primer paso para valorar su verdadero potencial.

Cambiar la forma de pensar

La computación cuántica suele presentarse como algo futurista, complejo o incluso misterioso. Sin embargo, en el fondo, su dificultad no está tanto en las matemáticas como en el cambio de mentalidad que exige.

Durante décadas hemos pensado en términos de bits con valores bien definidos. La computación cuántica nos obliga a dar un paso atrás y aceptar que, antes de obtener un resultado, la información puede describirse de otra manera: como estados, posibilidades y probabilidades que evolucionan siguiendo reglas muy precisas.

El qubit no es un bit mejor ni un sustituto del bit clásico. Es una pieza distinta, con un comportamiento propio, que solo tiene sentido cuando se entiende qué ocurre antes de medir. Cuando se comprende esto, desaparecen muchos mitos y la computación cuántica empieza a verse con más claridad.

Solo una herramienta nueva, potente en ciertos contextos y todavía en desarrollo.