Tabla de contenidos

- Introducción

- ¿Qué hace “bueno” a un hardware cuántico?

- Las grandes plataformas de hardware (con compañías)

- Superconductores (transmons, flux, etc.)

- Trampas de iones (trapped-ion)

- Átomos neutros (neutral atoms / Rydberg arrays)

- Fotónicos (photonic quantum computing)

- Espines en silicio (silicon spin qubits)

- Resonancia Magnética Nuclear (RMN / NMR)

- Topológicos (Majoranas / qubits topológicamente protegidos)

- Annealing cuántico (especializado en optimización)

- Tabla resumen de plataformas y compañías

- Cómo elegir «ganadores» sin caer en hype

- Conclusión final

Introducción

Cuando se habla de ordenadores cuánticos, es fácil caer en una idea simplificada: imaginar una única máquina cuántica, una especie de “superordenador del futuro” que sustituirá al ordenador clásico.

La realidad es bastante más interesante (y también más compleja): no existe un solo tipo de ordenador cuántico, sino varias tecnologías distintas compitiendo entre sí para resolver el mismo problema desde enfoques físicos muy diferentes.

Por eso tiene sentido hablar de hardware cuántico. Igual que en los inicios de la informática clásica convivieron válvulas de vacío, transistores, relés y distintos diseños de arquitecturas, hoy la computación cuántica se encuentra en una fase en la que coexisten múltiples caminos tecnológicos, ninguno claramente ganador todavía.

Mismo objetivo, caminos distintos

Aunque las tecnologías cuánticas sean muy diferentes entre sí, todas persiguen el mismo objetivo: construir un sistema capaz de procesar información cuántica de forma fiable, escalable y útil.

Para lograrlo, cualquier plataforma de hardware cuántico debe resolver, en mayor o menor medida, los mismos cuatro retos fundamentales:

- Qubits: cómo representar físicamente la unidad básica de información cuántica.

- Puertas cuánticas: cómo manipular esos qubits para realizar cálculos.

- Corrección de errores: cómo lidiar con el ruido y la fragilidad de los estados cuánticos.

- Escalado: cómo pasar de unos pocos qubits de laboratorio a cientos, miles o millones que permitan aplicaciones reales.

La diferencia está en cómo aborda cada tecnología estos retos. Algunas priorizan la estabilidad del qubit, otras la velocidad de operación, otras la facilidad de fabricación o el potencial de escalado industrial. No hay atajos: cada elección tiene ventajas y costes.

Qué cubre este artículo

En este artículo vamos a recorrer, con una mirada divulgativa y sin necesidad de conocimientos de física, las principales familias de hardware cuántico que existen hoy, explicando qué las hace distintas y qué empresas están apostando por cada una de ellas.

Hablaremos de:

- Qubits superconductores, una de las tecnologías más visibles actualmente.

- Trampas de iones, conocidas por su gran precisión y control.

- Átomos neutros, una vía prometedora para escalar grandes sistemas.

- Computación fotónica, basada en el uso de luz.

- Espines en silicio, que buscan aprovechar la experiencia de la industria de los semiconductores.

- Resonancia magnética nuclear (RMN), más habitual en contextos educativos y demostrativos.

- Qubits topológicos, una de las apuestas más ambiciosas a largo plazo.

- Y, como caso especial, el annealing cuántico, un enfoque más especializado que merece mención aparte.

El objetivo no es decidir cuál es “el mejor” ordenador cuántico, sino entender por qué existen tantos enfoques distintos y qué está intentando resolver cada uno.

Solo con ese contexto se puede interpretar correctamente titulares, anuncios de empresas o avances que aparecen a menudo en los medios.

¿Qué hace “bueno” a un hardware cuántico?

Cuando se comparan distintos tipos de ordenadores cuánticos, suele aparecer una pregunta aparentemente sencilla: ¿cuál es mejor?

La respuesta corta es incómoda pero honesta: depende de qué mires.

La respuesta útil es entender qué criterios hacen que un hardware cuántico sea realmente valioso, más allá del número de qubits que aparezca en una nota de prensa.

Antes de entrar en cada plataforma concreta, conviene fijar algunas ideas clave.

Qubit físico vs qubit lógico: La diferencia que lo cambia todo

No todos los qubits son iguales. De hecho, hay una distinción fundamental que marca toda la hoja de ruta de la computación cuántica:

- Qubit físico: Es el qubit “real”, el objeto físico que existe en el laboratorio (un circuito superconductivo, un ion, un átomo, un fotón…).

- Qubit lógico: Es un qubit “fiable”, construido a partir de muchos qubits físicos, gracias a técnicas de corrección de errores cuánticos.

Aquí está una de las claves más importantes del campo: Un ordenador cuántico útil no se mide por cuántos qubits físicos tiene, sino por cuántos qubits lógicos puede sostener.

Los qubits físicos son frágiles. Se descoherencian, se ven afectados por ruido, vibraciones, campos externos y pequeñas imperfecciones del entorno. La corrección de errores permite “proteger” la información cuántica, pero a un coste elevado: Un solo qubit lógico puede requerir decenas, cientos o incluso miles de qubits físicos, dependiendo de la calidad del hardware.

Por eso se dice que la corrección de errores manda la hoja de ruta. Todo el desarrollo de hardware está, en última instancia, orientado a reducir el número de qubits físicos necesarios por qubit lógico.

Métricas de alto nivel: Cómo se evalúa un hardware cuántico

Para entender la calidad de una plataforma cuántica, se usan varias métricas. No hace falta conocerlas en detalle técnico, pero sí entender qué mide cada una y por qué importa.

- Fidelidad de puertas: Indica qué tan bien se ejecutan las operaciones cuánticas. Una fidelidad alta significa menos errores al aplicar puertas lógicas.

- Conectividad: Describe qué qubits pueden interactuar directamente entre sí. Una buena conectividad simplifica los algoritmos y reduce errores adicionales.

- Coherencia: Mide cuánto tiempo un qubit mantiene su estado cuántico antes de perder la información. Más coherencia da más margen para calcular.

- Tasa de medida: Cómo de rápido y de forma fiable se puede medir un qubit al final del cálculo. Parece un detalle menor, pero es crucial para la corrección de errores y la lectura de resultados.

- Crosstalk (interferencias): Ocurre cuando operar sobre un qubit afecta involuntariamente a otros. A gran escala, el crosstalk se convierte en uno de los grandes enemigos del rendimiento.

- Estabilidad y calibración: Un hardware cuántico no sirve si necesita reajustes constantes. La estabilidad en el tiempo es tan importante como la calidad puntual.

- Coste energético e infraestructura: Criogenia extrema, sistemas ópticos complejos o electrónica de control avanzada influyen directamente en el coste y la viabilidad industrial.

- Manufacturabilidad (fabricar a escala): No basta con que algo funcione en el laboratorio. Hay que poder fabricar muchos dispositivos iguales, con calidad consistente. Esta métrica es clave para el futuro comercial.

Ninguna plataforma destaca en todas estas métricas a la vez. Cada tecnología optimiza algunas y sacrifica otras.

Por qué casi todo hoy es “NISQ” (y por qué eso confunde)

La mayoría de los ordenadores cuánticos actuales pertenecen a la era NISQ (Noisy Intermediate-Scale Quantum): sistemas con decenas o cientos de qubits físicos, todavía ruidosos y sin corrección de errores completa.

Esto tiene una consecuencia importante: en la era NISQ, algunas plataformas parecen mejores simplemente porque brillan en métricas visibles a corto plazo.

Por ejemplo, una tecnología con puertas muy rápidas o con muchos qubits físicos puede parecer superior, aunque tenga problemas serios de escalado o corrección de errores a largo plazo. Otra, más lenta pero más estable, puede quedar en segundo plano… hasta que la corrección de errores entra en juego.

Por eso, muchas comparaciones actuales son parciales y dependen mucho del contexto. El «mejor» hardware hoy no tiene por qué ser el que lidere dentro de diez o veinte años.

Las grandes plataformas de hardware (con compañías)

Superconductores (transmons, flux, etc.)

Los ordenadores cuánticos basados en superconductores son, hoy en día, los más visibles mediáticamente y también los que cuentan con una mayor inversión industrial. Para mucha gente, cuando se habla de computación cuántica, en realidad se está pensando (aunque no lo sepa) en esta tecnología.

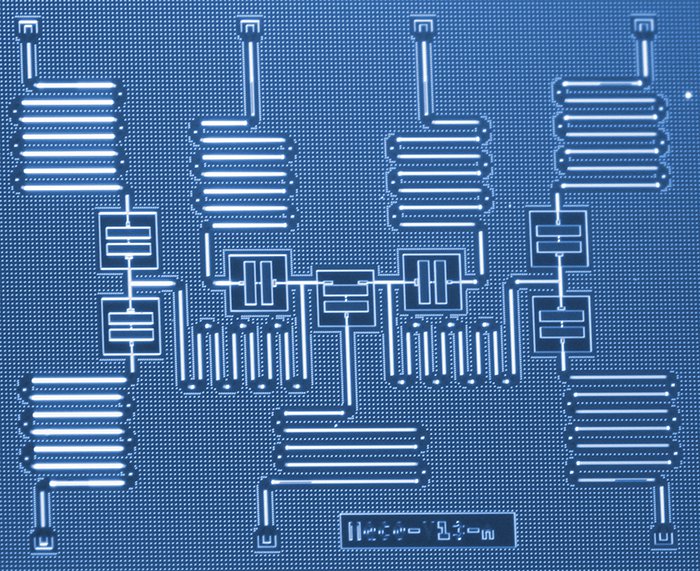

¿Qué son los qubits superconductores?

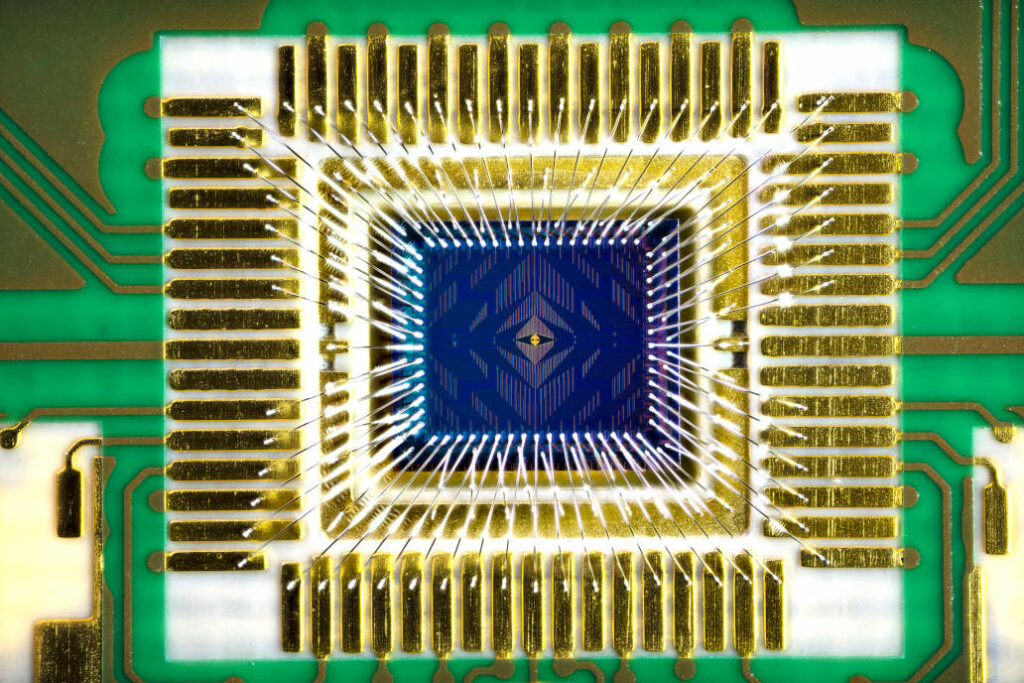

En esta plataforma, los qubits se construyen a partir de circuitos eléctricos especiales hechos con materiales superconductores. La clave es que estos circuitos se enfrían hasta temperaturas extremadamente bajas, cercanas al cero absoluto (del orden de milikelvin), donde la electricidad fluye sin resistencia y aparecen efectos cuánticos macroscópicos.

En ese régimen, el circuito deja de comportarse como un simple cable y pasa a tener niveles de energía bien definidos, que pueden usarse como los estados |0⟩ y |1⟩ de un qubit.

Diseños como los transmons o los qubits de flujo son variaciones de esta misma idea: Circuitos artificiales que imitan el comportamiento de sistemas cuánticos naturales.

Una analogía útil es pensar en ellos como «átomos artificiales» fabricados en un chip, en lugar de átomos reales atrapados en el vacío.

Por qué hay tanto interés los superconductores

Esta plataforma ha ganado tracción por varias razones muy prácticas:

- Puertas cuánticas muy rápidas: Las operaciones sobre qubits superconductores se realizan en tiempos extremadamente cortos. Esto permite ejecutar más operaciones antes de que el qubit pierda coherencia.

- Fuerte inversión y madurez industrial: Grandes empresas tecnológicas han apostado por esta vía, lo que acelera el desarrollo de herramientas, estándares y ecosistemas completos.

- Compatibilidad con técnicas de microfabricación: Los chips superconductores se fabrican con procesos similares a los de la industria de semiconductores, lo que facilita iterar diseños y producir nuevos dispositivos con relativa rapidez.

- Integración con electrónica de control: Aunque el entorno criogénico es exigente, la electrónica clásica que controla el sistema se integra bien con esta arquitectura.

Todo esto ha hecho que los superconductores sean una plataforma muy atractiva para avanzar rápido, especialmente en la era NISQ.

Retos típicos de esta tecnología

Pero el camino no está libre de obstáculos. Los principales retos aparecen cuando se intenta escalar el sistema:

- Cableado y control: Cada qubit necesita líneas de control y lectura. A medida que el número de qubits crece, el cableado dentro del criostato se vuelve un desafío de ingeniería enorme.

- Estabilidad y ruido: Pequeñas fluctuaciones eléctricas o térmicas pueden introducir errores. Mantener todos los qubits bien calibrados durante largos periodos no es trivial.

- Crosstalk al crecer el sistema: Al aumentar la densidad de qubits, las interferencias entre ellos se hacen más difíciles de controlar.

En resumen: los superconductores permiten crecer rápido, pero hacerlos realmente estables y escalables a gran tamaño es el gran reto actual.

Quién apuesta por superconductores

Varias de las compañías más influyentes del sector han elegido esta plataforma como base de su estrategia:

- IBM Quantum: Ha apostado claramente por qubits superconductores en toda su flota de procesadores. IBM publica hojas de ruta detalladas y ofrece acceso a sus QPUs a través de la nube, lo que ha contribuido mucho a popularizar esta tecnología.

- Google Quantum AI: Utiliza chips superconductores en sus procesadores más conocidos, como Sycamore o Willow. Su enfoque combina investigación fundamental con demostraciones de alto impacto.

- Rigetti: Desarrolla procesadores superconductores propios y los ofrece mediante servicios cloud, con una estrategia muy centrada en hardware + software integrado.

El ecosistema que rodea a los superconductores

Más allá de los chips, esta plataforma ha impulsado un ecosistema completo:

- Sistemas de criogenia avanzada

- Electrónica de control de alta precisión

- Herramientas de diseño y simulación de circuitos cuánticos

- Foundries especializadas en fabricar dispositivos superconductores

Este ecosistema es una de sus grandes fortalezas… y también una razón por la que muchos creen que los superconductores seguirán siendo protagonistas durante bastante tiempo, incluso aunque no sean la solución definitiva a largo plazo.

Trampas de iones (trapped-ion)

Si los superconductores se apoyan en “átomos artificiales” fabricados en chips, la computación cuántica con trampas de iones apuesta por algo mucho más literal: átomos reales, cargados eléctricamente, flotando en el vacío y controlados con enorme precisión.

Esta es una de las plataformas más elegantes desde el punto de vista conceptual… y también una de las más exigentes en ingeniería.

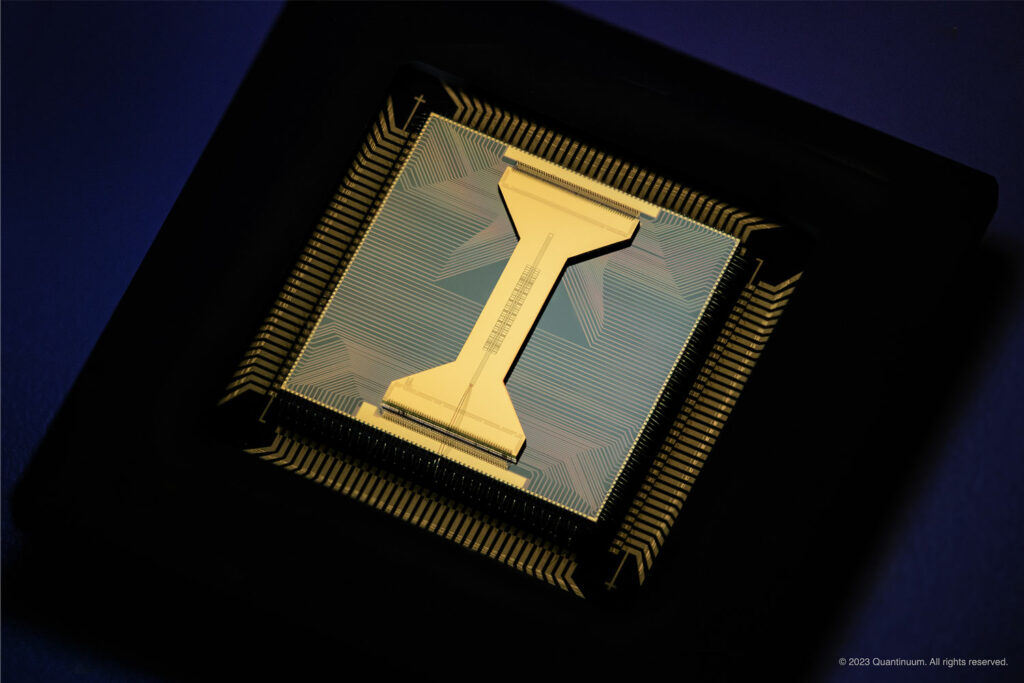

¿Qué son las trampas de iones?

Un ion es un átomo que ha perdido (o ganado) electrones y, por tanto, tiene carga eléctrica.

En esta tecnología, iones individuales se mantienen suspendidos en el vacío mediante campos electromagnéticos, formando pequeñas “cadenas” o estructuras controladas.

Cada ion actúa como un qubit. Sus estados cuánticos se manipulan mediante láseres o microondas, que permiten cambiar el estado del qubit (puertas cuánticas), entrelazar distintos iones, y medir el resultado del cálculo.

Una forma intuitiva de pensarlo es como un collar de perlas flotando, donde cada perla es un ion idéntico y perfectamente controlable.

Por qué hay interés en las trampas de iones

Esta plataforma tiene varias ventajas muy valoradas en computación cuántica:

- Qubits extremadamente “uniformes”: Todos los iones de un mismo tipo son prácticamente idénticos. Esto reduce variaciones entre qubits y simplifica el control.

- Alta fidelidad de operaciones: Las puertas cuánticas suelen ser muy precisas, con tasas de error bajas comparadas con otras tecnologías.

- Conectividad favorable: En muchos diseños, cualquier ion puede interactuar con cualquier otro dentro de la misma trampa, lo que simplifica la implementación de algoritmos.

- Estados cuánticos bien aislados: Al estar suspendidos en el vacío, los iones están relativamente protegidos del entorno, lo que ayuda a mantener la coherencia.

Por todo esto, las trampas de iones son una plataforma muy atractiva cuando se piensa en corrección de errores cuánticos y qubits lógicos de alta calidad.

Retos típicos de esta tecnología

Las ventajas no vienen gratis. Los principales desafíos aparecen al intentar escalar el sistema:

- Velocidad de las puertas: Las operaciones suelen ser más lentas que en superconductores. Esto obliga a equilibrar precisión frente a tiempo de cálculo.

- Complejidad de los sistemas ópticos: Controlar muchos iones requiere láseres muy estables, alineados con extrema precisión. A gran escala, el sistema óptico se vuelve muy complejo.

- Escalado físico: Mantener largas cadenas de iones o interconectar múltiples trampas es un reto activo de investigación e ingeniería.

En resumen, las trampas de iones ofrecen calidad y control, pero el gran desafío es hacerlas crecer sin perder esas ventajas.

Quién apuesta por trampas de iones

Varias empresas líderes han hecho una apuesta clara por esta tecnología:

- IonQ: Declara explícitamente su enfoque en trampas de iones. Ha sido una de las compañías más visibles en llevar esta tecnología a servicios cloud comerciales.

- Quantinuum: Desarrolla sistemas como las series H1 y H2, basados en trampas de iones, con un fuerte énfasis en fidelidad, corrección de errores y software cuántico.

- Oxford Ionics: Especializada en trampas de iones con control electrónico avanzado. En 2025, IonQ anunció la integración/adquisición de la compañía, reforzando su apuesta por esta vía.

Una idea clave para quedarse

Si los superconductores destacan por velocidad e impulso industrial, las trampas de iones destacan por precisión y uniformidad. Por eso muchos expertos las ven como una candidata muy seria para construir qubits lógicos de alta calidad, aunque el camino hacia grandes sistemas escalables sea más lento y técnicamente complejo.

Átomos neutros (neutral atoms / Rydberg arrays)

La computación cuántica con átomos neutros propone una idea muy distinta a la de superconductores o trampas de iones: en lugar de fabricar qubits en chips o cargar átomos, se trabaja con átomos neutros reales, enfriados casi hasta el cero absoluto y organizados con láseres como si fueran piezas de un tablero.

Es una de las plataformas que más interés está generando en los últimos años, sobre todo por su potencial de escalado.

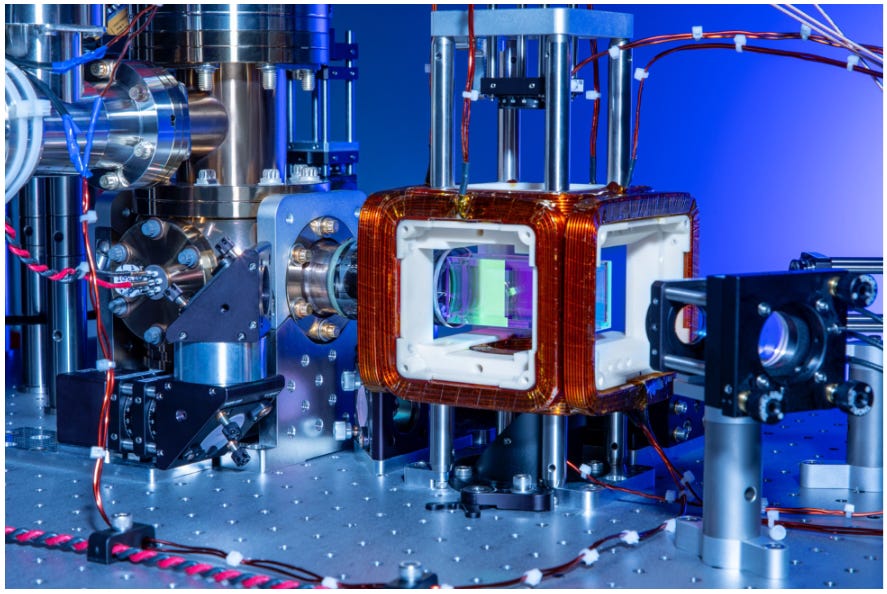

¿Qué son los átomos neutros?

En esta tecnología, se utilizan átomos neutros ultrafríos que se mantienen suspendidos mediante pinzas ópticas, es decir, haces de láser extremadamente precisos que “atrapan” cada átomo en una posición concreta del espacio.

Cada átomo actúa como un qubit. Para que dos qubits interactúen, se excita temporalmente el átomo a un estado de Rydberg, un estado especial en el que el átomo se vuelve mucho más sensible a la presencia de otros átomos cercanos. Esa interacción es la que permite implementar puertas cuánticas y entrelazamiento.

Una analogía útil es imaginar un tablero de ajedrez tridimensional, donde cada casilla contiene un átomo idéntico y los láseres hacen de “manos invisibles” que los controlan y conectan cuando hace falta.

Por qué hay interés en los átomos neutros

Esta plataforma resulta especialmente atractiva por varias razones:

- Escalado geométrico muy natural: Es relativamente sencillo crear arreglos con decenas, cientos o incluso miles de átomos organizados en patrones regulares. Añadir más qubits es, en cierto sentido, “poner más átomos en el tablero”.

- Uniformidad natural de los qubits: Todos los átomos de una misma especie son idénticos por naturaleza, lo que reduce variaciones entre qubits y simplifica ciertos aspectos del control.

- Flexibilidad en la conectividad: Cambiando la disposición de las pinzas ópticas, se pueden definir diferentes geometrías de interacción entre qubits, algo muy valioso para ciertos algoritmos.

- Menor dependencia de microfabricación compleja: A diferencia de los chips, aquí gran parte de la “arquitectura” se define ópticamente, lo que abre caminos distintos al escalado industrial.

Por todo ello, muchos ven los átomos neutros como una plataforma prometedora para sistemas grandes, incluso antes de que la corrección de errores esté plenamente desplegada.

Retos típicos de esta tecnología

El atractivo del escalado viene acompañado de desafíos importantes:

- Control fino a gran escala: Controlar unos pocos átomos es relativamente manejable; hacerlo con cientos o miles requiere una precisión extrema en láseres, sincronización y estabilidad.

- Fidelidades de puertas: Aunque el número de qubits puede crecer rápido, mantener altas fidelidades en todas las operaciones a gran escala es uno de los grandes retos actuales.

- Del “muchos átomos” al cómputo universal: No basta con tener muchos qubits: hay que implementar puertas universales y, a largo plazo, corrección de errores cuánticos. Traducir el escalado geométrico en qubits lógicos útiles es una de las preguntas abiertas del campo.

En otras palabras: los átomos neutros escalan bien en número, pero el desafío es convertir ese número en capacidad de cómputo fiable.

Quién apuesta por átomos neutros

Varias compañías punteras han hecho de esta tecnología el núcleo de su estrategia:

- Pasqal: Ha apostado claramente por ordenadores cuánticos basados en átomos neutros, con un fuerte enfoque en escalado y aplicaciones prácticas.

- QuEra: Desarrolla plataformas de átomos neutros como Aquila, muy utilizadas en investigación y accesibles vía cloud, con una hoja de ruta orientada a sistemas cada vez mayores.

- Atom Computing: Trabaja en grandes arrays de átomos neutros y colabora estrechamente con Microsoft en el desarrollo de esta tecnología.

- Infleqtion: Ofrece una línea completa de soluciones basadas en átomos neutros, desde investigación hasta aplicaciones comerciales.

La idea clave de esta plataforma

Los átomos neutros representan una apuesta clara por crecer en número primero y resolver después el reto del cómputo universal y la corrección de errores. Si esa transición tiene éxito, podrían convertirse en una de las plataformas más escalables del ecosistema cuántico.

Fotónicos (photonic quantum computing)

La computación cuántica fotónica se apoya en una idea muy intuitiva: usar la luz como portadora de información cuántica. En lugar de átomos, iones o circuitos superconductores, aquí los qubits se codifican en fotones y se manipulan mediante circuitos fotónicos integrados, una tecnología muy cercana a la que ya se usa en telecomunicaciones.

Es una plataforma conceptualmente elegante y, para muchos, una de las apuestas más atractivas a largo plazo.

¿Qué son los ordenadores cuánticos fotónicos?

En este enfoque, la información cuántica se codifica en estados de la luz: por ejemplo, en la polarización de un fotón, en su fase o en distintos modos ópticos.

Los fotones se guían a través de chips fotónicos, que funcionan como “circuitos de luz” con interferómetros, divisores de haz y moduladores. Al recorrer estos circuitos, los fotones interfieren entre sí y realizan el cálculo cuántico.

Una analogía útil es imaginar un laberinto de espejos y guías de luz, donde el propio recorrido de los fotones implementa el algoritmo.

Por qué hay interés en los fotónicos

La computación cuántica fotónica tiene varias ventajas muy llamativas:

- Menor dependencia de temperaturas extremas: A diferencia de los superconductores, los sistemas fotónicos no necesitan criogenia extrema para que el qubit “exista”. Esto reduce, al menos en principio, la complejidad de la infraestructura.

- Compatibilidad con fabricación fotónica: Los circuitos fotónicos pueden fabricarse usando tecnologías de silicon photonics, cercanas a los procesos industriales actuales. Esto abre la puerta a producir chips cuánticos en foundries especializadas.

- Excelente candidata para networking cuántico: La luz es el medio natural para transmitir información a largas distancias. Por eso, la fotónica es clave no solo para computación, sino también para comunicaciones cuánticas y futuras redes cuánticas.

- Qubits poco sensibles al entorno: Los fotones interactúan muy poco con el medio, lo que reduce ciertos tipos de ruido y decoherencia.

Estas características hacen que muchos vean la fotónica como una plataforma con gran potencial a largo plazo, especialmente cuando se piensa en sistemas distribuidos.

Retos típicos de esta tecnología

Precisamente porque los fotones interactúan poco, aparecen los principales desafíos:

- Fuentes y detectores de fotones: Generar fotones individuales de forma fiable y detectarlos sin introducir errores es técnicamente complejo.

- Pérdidas ópticas: Cada vez que un fotón se pierde en el circuito, la información cuántica se pierde con él. Minimizar estas pérdidas es crucial.

- Corrección de errores eficiente: La corrección de errores en fotónica suele requerir arquitecturas muy específicas y un gran número de recursos adicionales, lo que complica el diseño de sistemas escalables.

- Arquitecturas más complejas: Implementar computación universal con fotones implica esquemas menos directos que en otras plataformas, lo que eleva la dificultad técnica.

En resumen: los fotónicos son muy prometedores, pero el camino hacia qubits lógicos prácticos es especialmente exigente.

Quién apuesta por computación cuántica fotónica

Dos compañías destacan claramente en esta plataforma:

- PsiQuantum: Ha apostado por una estrategia fotónica muy ambiciosa, basada en silicon photonics y fabricación a escala industrial. Su objetivo declarado es construir un ordenador cuántico tolerante a fallos directamente con esta tecnología.

- Xanadu: Desarrolla ordenadores cuánticos fotónicos y los ofrece como su plataforma principal, combinando hardware con software específico para este enfoque.

La idea clave de la fotónica

La computación cuántica fotónica apuesta por integración, comunicación y escalado industrial, incluso a costa de una arquitectura más compleja.

Si se superan los retos de pérdidas y corrección de errores, podría convertirse en una de las plataformas más naturales para un futuro cuántico interconectado.

Espines en silicio (silicon spin qubits)

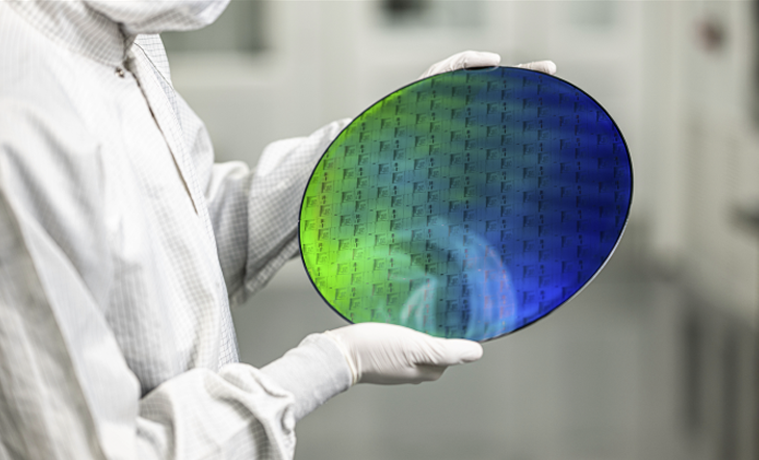

La computación cuántica basada en espines en silicio es, probablemente, la plataforma que más directamente conecta el mundo cuántico con la industria clásica de los semiconductores. Su gran promesa es clara: construir qubits utilizando materiales, procesos y conocimientos muy cercanos a los que ya se emplean para fabricar chips convencionales.

¿Qué son los espines en silicio?

En esta tecnología, el qubit no es un átomo completo ni un circuito macroscópico, sino una propiedad muy concreta de una partícula: el espín.

El espín es una característica cuántica de electrones (o núcleos) que puede interpretarse, de forma intuitiva, como una especie de “orientación” interna. Si se confina un electrón en un punto cuántico dentro de un dispositivo de silicio, su espín puede representar los estados |0⟩ y |1⟩ de un qubit.

Estos puntos cuánticos se crean usando estructuras nanométricas muy similares a las que ya existen en la microelectrónica moderna. Es decir: el qubit vive literalmente dentro de un chip de silicio.

Por qué hay interés en los espines en silicio

El atractivo de esta plataforma está muy ligado a su potencial industrial:

- Alta densidad de qubits: Los espines ocupan muy poco espacio físico, lo que permite imaginar chips con un número enorme de qubits en áreas reducidas.

- Manufacturabilidad cercana a CMOS: Muchas de las técnicas necesarias para fabricar estos dispositivos son compatibles, o al menos cercanas, a los procesos estándar de la industria del silicio. Esto es un punto clave frente a otras plataformas más “artesanales”.

- Experiencia acumulada de décadas: La industria de semiconductores lleva más de medio siglo perfeccionando el control del silicio. Aprovechar ese conocimiento es una ventaja estratégica enorme.

- Posible integración con electrónica clásica: A largo plazo, se vislumbra la posibilidad de integrar qubits y electrónica de control en el mismo entorno tecnológico.

Por todo ello, los espines en silicio suelen verse como una apuesta a medio y largo plazo, muy alineada con la idea de fabricar ordenadores cuánticos de forma masiva.

Retos típicos de esta tecnología

El potencial viene acompañado de desafíos técnicos muy exigentes:

- Control y lectura de alta fidelidad: Manipular y medir el espín de un solo electrón con precisión extrema no es trivial, y hacerlo de forma repetible a gran escala es aún más difícil.

- Interconexión entre qubits: Conectar muchos puntos cuánticos para que interactúen de forma controlada requiere una ingeniería muy sofisticada.

- Variabilidad a nivel nanométrico: Pequeñas imperfecciones en la fabricación pueden tener un impacto significativo en el comportamiento cuántico del dispositivo.

- Entornos operativos exigentes: Aunque el material sea silicio, estos sistemas siguen requiriendo temperaturas muy bajas y control preciso del entorno.

En resumen: es una plataforma con gran promesa de escalado, pero con una barrera tecnológica alta en las fases iniciales.

Quién apuesta por espines en silicio

La empresa que ha hecho una apuesta más clara y sostenida por esta tecnología es:

- Intel: Intel ha declarado explícitamente su foco en silicon spin qubits, aprovechando su experiencia en fabricación avanzada y procesos industriales. Su estrategia está muy orientada a demostrar que esta plataforma puede escalar de forma realista.

La idea clave de esta plataforma

Los espines en silicio representan una visión muy concreta del futuro cuántico:

ordenadores cuánticos fabricados como chips, no como instalaciones de laboratorio.

Si se logra dominar el control y la interconexión de estos qubits, esta plataforma podría convertirse en una de las más escalables desde el punto de vista industrial.

Resonancia Magnética Nuclear (RMN / NMR)

La computación cuántica basada en resonancia magnética nuclear (RMN) es, en cierto modo, una veterana dentro del campo. Fue una de las primeras tecnologías con las que se demostraron algoritmos cuánticos… pero hoy ocupa un lugar muy específico dentro del ecosistema: educación, demostración y divulgación, más que la carrera hacia grandes ordenadores cuánticos.

¿Qué es la computación cuántica por RMN?

En este enfoque, los qubits se codifican en espines nucleares, normalmente de núcleos atómicos presentes en moléculas. Estos espines se controlan mediante pulsos de radiofrecuencia (RF), una técnica bien conocida en química y en imagen médica (como las resonancias magnéticas).

A diferencia de otras plataformas, aquí no se trabaja con qubits individuales bien separados, sino con conjuntos de moléculas que se comportan de forma muy controlada. Las operaciones cuánticas se implementan ajustando cuidadosamente los pulsos de RF para manipular los espines nucleares.

Una analogía sencilla es pensar en una orquesta perfectamente sincronizada, donde no se controla a cada músico por separado, sino al conjunto completo con una partitura muy precisa.

Dónde encaja hoy esta tecnología

Históricamente, la RMN fue clave para demostrar que los principios de la computación cuántica funcionaban, implementar versiones tempranas de algoritmos cuánticos, y formar a muchas generaciones de investigadores.

Sin embargo, a día de hoy presenta limitaciones claras:

- Escalado muy limitado: Aumentar el número de qubits es extremadamente difícil con este enfoque.

- Dificultad para corrección de errores cuánticos: La forma en que se codifica y controla la información hace muy compleja la implementación de esquemas modernos de corrección de errores.

- Enfoque colectivo, no individual: Al no manipular qubits individuales de manera directa, resulta poco adecuada para arquitecturas cuánticas a gran escala.

Por todo ello, la RMN no se considera una ruta principal hacia ordenadores cuánticos “utility-scale” (útiles a nivel industrial o científico), pero sigue siendo muy valiosa como plataforma educativa y experimental.

Por qué sigue siendo importante

A pesar de no liderar la carrera tecnológica, la RMN tiene un papel claro:

- Excelente herramienta pedagógica: Permite enseñar conceptos clave de computación cuántica con hardware real, de forma controlada y relativamente accesible.

- Demostraciones reproducibles: Es una tecnología madura, estable y bien entendida, ideal para entornos docentes.

- Puente entre teoría y práctica: Ayuda a comprender cómo los algoritmos cuánticos se traducen en pulsos y operaciones físicas reales.

En este sentido, la RMN funciona como un laboratorio cuántico didáctico, más que como un prototipo del ordenador cuántico del futuro.

Quién apuesta por RMN (principalmente educación)

La empresa más representativa en este ámbito es:

- SpinQ: SpinQ comercializa equipos de computación cuántica basados en RMN de escritorio, como sistemas de pocos qubits (por ejemplo, 2 o 3), pensados para docencia, divulgación y formación práctica.

La idea clave de la RMN

La resonancia magnética nuclear no compite en la carrera por el ordenador cuántico más potente. Su valor está en otro sitio: hacer la computación cuántica tangible, comprensible y enseñable.

Por eso, aunque no sea la tecnología que escale a miles de qubits, sigue ocupando un lugar relevante en el ecosistema cuántico actual.

Topológicos (Majoranas / qubits topológicamente protegidos)

Los qubits topológicos representan, probablemente, la apuesta más ambiciosa (y también la más exigente) de todo el panorama del hardware cuántico. La promesa es enorme: reducir drásticamente los errores desde la propia física del sistema, en lugar de combatirlos solo con capas cada vez más complejas de corrección de errores.

Si funcionaran tal y como se espera, podrían cambiar por completo la hoja de ruta de la computación cuántica.

¿Qué son los qubits topológicos?

La idea central es conceptualmente distinta a la del resto de plataformas. En lugar de intentar aislar al máximo un qubit frágil y corregir errores constantemente, los qubits topológicos buscan proteger la información cuántica de forma intrínseca, usando propiedades topológicas del sistema físico.

Dicho de forma sencilla: la información no se guarda en un punto concreto, sino “distribuida” en la estructura global del sistema.

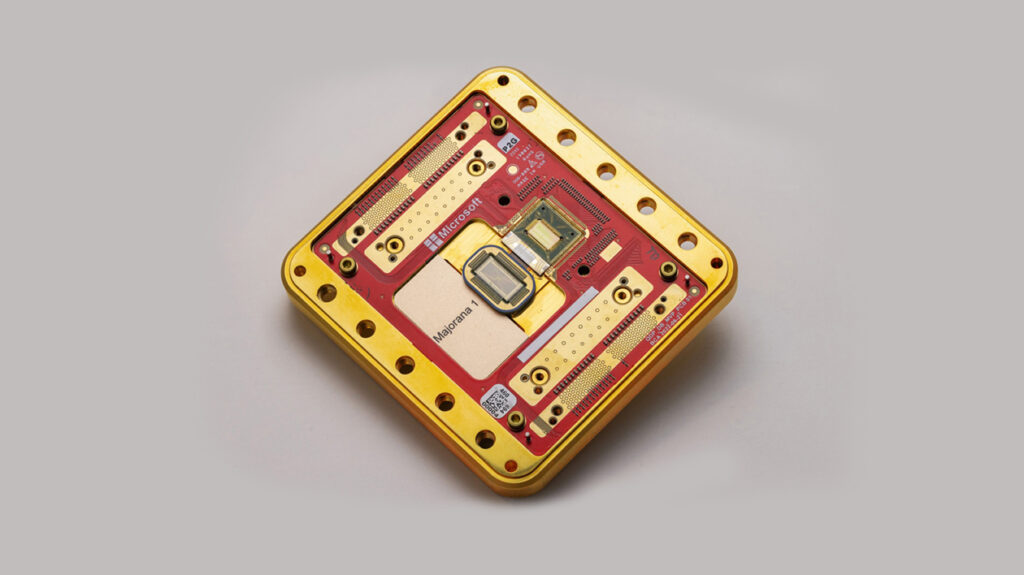

Uno de los candidatos más conocidos para lograr esto son los modos de Majorana, excitaciones cuánticas que, en ciertos materiales y condiciones extremas, se comportan como si fueran partículas “partidas en dos”. Al separar espacialmente estas partes, la información cuántica queda protegida frente a muchas perturbaciones locales.

Una analogía útil es pensar en un nudo en una cuerda: puedes estirar, mover o sacudir la cuerda, pero el nudo sigue siendo el mismo mientras no la cortes. Esa “robustez” es lo que se busca con la topología.

Por qué hay tanto interés en los topológicos

El atractivo de los qubits topológicos está claro:

- Menor carga de corrección de errores: Si el qubit es intrínsecamente robusto, se necesitarían muchos menos qubits físicos para construir un qubit lógico.

- Mayor estabilidad frente al ruido: Muchas perturbaciones locales no afectarían directamente a la información cuántica.

- Cambio de paradigma: En lugar de “luchar contra los errores”, la física del sistema ayudaría a evitarlos desde el inicio.

Por estas razones, los qubits topológicos suelen describirse como un posible “salto cualitativo” en computación cuántica.

Retos típicos: la ruta más exigente

La otra cara de la moneda es que esta es, con diferencia, la ruta más difícil desde el punto de vista experimental:

- Materiales y dispositivos extremadamente complejos: Requieren combinaciones muy específicas de superconductores, semiconductores y campos magnéticos.

- Demostraciones sólidas y reproducibles: No basta con señales prometedoras: la comunidad exige evidencias claras, repetibles y bien entendidas de que los modos topológicos existen y pueden manipularse de forma fiable.

- Tecnología aún en fase muy temprana: A diferencia de otras plataformas, aquí todavía se está validando la base física sobre la que se construirían los qubits.

Por eso, aunque la promesa es enorme, los qubits topológicos se consideran una apuesta a largo plazo, con un nivel de riesgo elevado.

Quién apuesta por qubits topológicos

La empresa que ha defendido con más claridad y continuidad esta visión es:

- Microsoft: Microsoft lleva años desarrollando una hoja de ruta basada en qubits topológicos y modos de Majorana, integrando esta apuesta dentro de su estrategia de computación cuántica y su plataforma en la nube.

La idea clave de los qubits topológicos

Los qubits topológicos no buscan avanzar paso a paso, sino resolver el problema de los errores de raíz. Si la protección topológica se confirma y se puede escalar, esta plataforma podría reducir de forma drástica la complejidad de los ordenadores cuánticos.Pero también es la apuesta que más paciencia exige: todo depende de que la física responda como se espera.

Annealing cuántico (especializado en optimización)

Cuando se habla de ordenadores cuánticos, suele asumirse que todas las máquinas siguen el mismo modelo de funcionamiento. Sin embargo, el annealing cuántico es un buen recordatorio de que no toda la computación cuántica busca ser universal.

Este enfoque ocupa un lugar particular en el ecosistema: no pretende ejecutar cualquier algoritmo cuántico, sino resolver muy bien un tipo concreto de problemas.

¿Qué es el annealing cuántico?

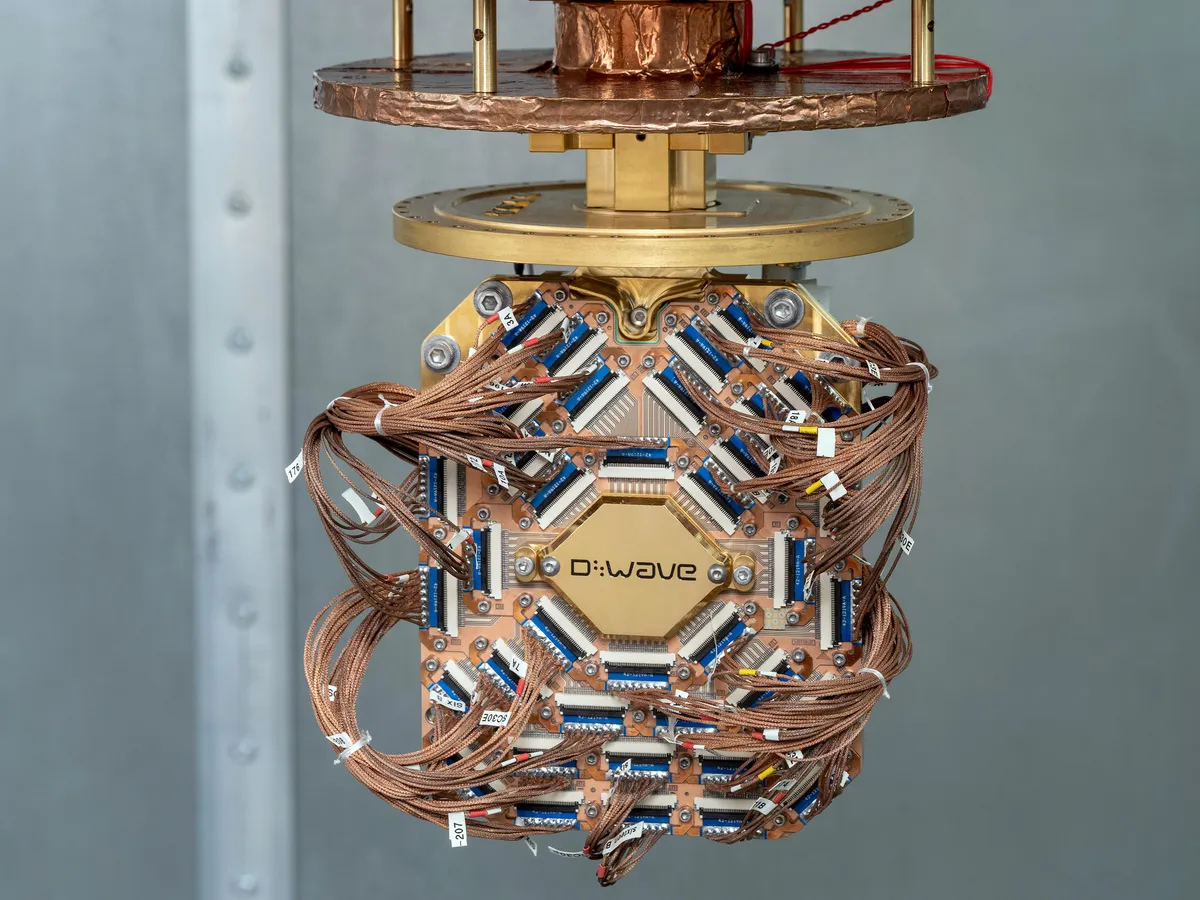

El annealing cuántico no se basa en aplicar puertas cuánticas una tras otra, como hacen los ordenadores cuánticos universales. En su lugar, el problema que se quiere resolver se traduce a una función de energía, y el sistema cuántico se deja evolucionar hacia su estado de mínima energía.

Dicho de forma sencilla: resolver el problema equivale a encontrar el punto más bajo de un «paisaje de energía».

El annealing cuántico es una versión práctica, restringida y orientada a optimización de la computación adiabática. Este tipo de formulación es especialmente natural para problemas de optimización combinatoria, que pueden expresarse como modelos Ising o QUBO (Quadratic Unconstrained Binary Optimization).

Una analogía clara es imaginar una bola rodando por un terreno montañoso: el annealing busca que la bola termine en el valle más profundo posible.

En qué se diferencia del cómputo cuántico universal

Es importante subrayar esta diferencia para evitar confusiones:

- No es un modelo de puertas universal: No puede ejecutar algoritmos generales como Shor o Grover de la misma forma que un ordenador cuántico universal.

- Está especializado: Funciona bien cuando el problema encaja de forma natural en una formulación de optimización.

- La corrección de errores juega un papel distinto: El enfoque tolera ciertos tipos de ruido de forma diferente, pero no sustituye la corrección de errores del modelo universal.

Por eso, el annealing cuántico suele considerarse un «primo especializado» de la computación cuántica universal, no un competidor directo.

Por qué sigue siendo relevante

A pesar de no ser universal, el annealing cuántico tiene ventajas claras:

- Aplicaciones concretas desde fases tempranas: Optimización de rutas, asignación de recursos, finanzas, logística o planificación industrial.

- Hardware disponible comercialmente desde hace años: Es una de las pocas tecnologías cuánticas que lleva tiempo en producción real.

- Puente entre lo clásico y lo cuántico: Muchas técnicas híbridas combinan heurísticas clásicas con annealing cuántico.

En este sentido, el annealing ha permitido que muchas empresas experimenten con hardware cuántico real, incluso antes de la llegada de qubits lógicos.

Quién domina comercialmente el annealing cuántico

La empresa claramente dominante en este ámbito es:

- D-Wave: Ha desarrollado sistemas de annealing cuántico basados en qubits superconductores de flujo (flux qubits), y los ha llevado al mercado mediante soluciones comerciales y acceso cloud. Su tecnología se ha utilizado ampliamente en investigación aplicada y pruebas industriales.

La idea clave del annealing cuántico

El annealing cuántico no pretende ser «el ordenador cuántico del futuro» en sentido general. Su valor está en resolver bien problemas de optimización, aquí y ahora, con hardware cuántico especializado.

Por eso, cuando alguien pregunta por «tipos de ordenadores cuánticos», el annealing suele aparecer en la conversación: no porque sea universal, sino porque ya está encontrando su sitio dentro del ecosistema cuántico.

Tabla resumen de plataformas y compañías

| Plataforma de hardware cuántico | Idea clave | Empresas que apuestan por ella |

| Superconductores | Circuitos superconductores a temperaturas criogénicas; puertas rápidas y fuerte ecosistema industrial | IBM Quantum, Google Quantum AI, Rigetti |

| Trampas de iones | Iones individuales controlados con láser/microondas; gran precisión y uniformidad | IonQ, Quantinuum, Oxford Ionics |

| Átomos neutros | Átomos ultrafríos en pinzas ópticas; escalado geométrico atractivo | Pasqal, QuEra, Atom Computing, Infleqtion |

| Fotónicos | Qubits en estados de luz; integración fotónica y redes cuánticas | PsiQuantum, Xanadu |

| Espines en silicio | Espín de electrones en puntos cuánticos de silicio; enfoque CMOS | Intel |

| RMN / NMR | Espines nucleares controlados por RF; enfoque educativo | SpinQ |

| Topológicos | Protección intrínseca mediante propiedades topológicas | Microsoft |

| Annealing cuántico | Optimización vía mínimos de energía (Ising/QUBO) | D-Wave |

Cómo elegir «ganadores» sin caer en hype

Cuando se sigue la actualidad de la computación cuántica, es fácil sentirse desorientado. Cada pocos meses aparecen titulares sobre nuevos récords, más qubits o avances “históricos”. El problema no es que esos avances no sean reales, sino que suelen contarse sin contexto.

Esta sección no busca decir quién va a ganar, sino ofrecer criterios para leer las noticias con cabeza.

Evitar la trampa de «más qubits = mejor»

El error más común (y el más explotado mediáticamente) es equiparar número de qubits con capacidad real de cómputo.

Como hemos visto antes, no todos los qubits cuentan igual:

- Qubits físicos: Los que se anuncian en notas de prensa.

- Qubits lógicos: Los que realmente sirven para calcular de forma fiable.

Un sistema con muchos qubits físicos, pero baja fidelidad o mala conectividad, puede ser menos útil que otro con menos qubits, pero mejor controlados.

Para evaluar un anuncio, conviene preguntarse:

- ¿Qué fidelidad tienen las puertas?

- ¿Cómo es la conectividad entre qubits?

- ¿Existe una ruta clara hacia qubits lógicos?

- ¿El sistema se puede mantener estable durante horas o días?

Si estas preguntas no tienen respuesta clara, el número de qubits por sí solo dice muy poco.

Entender el enfoque «full stack» frente a la especialización

Otra clave importante es que no todas las empresas juegan al mismo juego.

Algunas apuestan por un enfoque full stack: hardware + software + herramientas + acceso en la nube.

El objetivo es ofrecer una plataforma completa, incluso aunque el hardware todavía no sea perfecto.

Otras se centran casi exclusivamente en una pieza del puzzle:

- Mejorar el qubit físico

- Desarrollar mejores materiales

- Resolver problemas muy concretos (como la optimización)

Ninguna estrategia es intrínsecamente mejor que la otra. Simplemente responden a horizontes temporales distintos:

- Corto plazo: acceso, experimentación, ecosistema;

- Largo plazo: qubits lógicos estables y escalables.

Comparar empresas sin tener en cuenta este contexto suele llevar a conclusiones erróneas.

Asumir que las apuestas mixtas son normales

En computación cuántica, cambiar de estrategia no es un fracaso. Es parte natural del proceso.

A lo largo del tiempo, muchas organizaciones investigan varias plataformas en paralelo, ajustan su enfoque según avances en materiales o control, o combinan tecnologías distintas (por ejemplo, hardware cuántico + algoritmos clásicos).

Esto no indica indecisión, sino incertidumbre tecnológica real. Todavía no sabemos qué combinación exacta de qubits, control y corrección de errores será la más viable a gran escala.

Por eso, las apuestas mixtas (o los cambios de rumbo) son una señal de madurez, no de debilidad.

La idea clave

Si hay una idea con la que conviene quedarse, es esta: en computación cuántica, los verdaderos “ganadores” no se verán a corto plazo, y probablemente no serán los que hoy hacen más ruido.

El progreso real se mide en:

- Reducción de errores

- Estabilidad a largo plazo

- Capacidad de fabricar y controlar sistemas complejos

- Avance hacia qubits lógicos útiles

Todo lo demás es contexto, marketing o exploración necesaria.Con esta mirada, leer sobre hardware cuántico deja de ser un desfile de promesas y pasa a ser lo que realmente es: una carrera tecnológica profunda, lenta y fascinante.

Conclusión final

Después de recorrer las principales plataformas de hardware cuántico, queda clara una idea fundamental: no existe una única forma “correcta” de construir un ordenador cuántico.

Cada tecnología compra ventajas concretas a cambio de problemas distintos:

- Los superconductores avanzan rápido gracias a su ecosistema industrial, pero lidian con el escalado y la estabilidad.

- Las trampas de iones ofrecen qubits de gran calidad, a costa de sistemas más complejos y lentos.

- Los átomos neutros prometen crecer en número de forma natural, con el reto de convertir ese número en cómputo fiable.

- La fotónica apuesta por integración y comunicación, enfrentándose a pérdidas y arquitecturas exigentes.

- Los espines en silicio buscan llevar la computación cuántica al terreno de la fabricación masiva.

- La RMN cumple un papel clave en educación y divulgación, aunque no marque el camino hacia sistemas a gran escala.

- Los qubits topológicos aspiran a resolver el problema de los errores desde la raíz, con una dificultad experimental enorme.

- El annealing cuántico ocupa su propio espacio, resolviendo problemas de optimización sin pretender ser universal.

Visto así, la diversidad no es una debilidad del campo, sino su mayor fortaleza: explorar varios caminos a la vez es la única forma razonable de avanzar cuando el destino aún no está claro.

Y por eso conviene cerrar con una idea sencilla, pero poderosa: La pregunta no es qué hardware es “el mejor”, sino cuál escala antes a qubits lógicos útiles con un coste asumible.

Esa es la vara de medir real de la computación cuántica. Todo lo demás (récords puntuales, titulares llamativos o números aislados) sólo tiene sentido cuando se interpreta a la luz de esa pregunta.