Tabla de contenidos

- ¿Qué se ha inaugurado exactamente?

- El corazón del sistema: IBM Quantum Heron (156 qubits)

- La parte que casi nadie explica: el frío extremo y la ingeniería real

- ¿Por qué es un hito para Europa?

- Del “futuro” a la utilidad: el mensaje más importante de IBM

- ¿Para qué servirá? (Aplicaciones con impacto real)

- BasQ y el ecosistema: la clave no es la máquina, es la estrategia

- ¿Qué significa esto para la computación cuántica en España?

- Conclusión

La computación cuántica en Europa acaba de dar un salto estratégico. Donostia/San Sebastián se ha convertido en el primer lugar del continente en albergar un IBM Quantum System Two operativo, una de las plataformas cuánticas más avanzadas desarrolladas por IBM hasta la fecha. Y no es un dato menor: este sistema es uno de los pocos existentes a nivel mundial y representa un paso clave hacia la era de la computación cuántica útil (utility-scale quantum computing).

Pero… ¿Qué significa realmente este acontecimiento? ¿Estamos ante una “máquina del futuro” o ante una infraestructura científica real con impacto en industria, IA y biomedicina? Vamos a desgranarlo.

¿Qué se ha inaugurado exactamente?

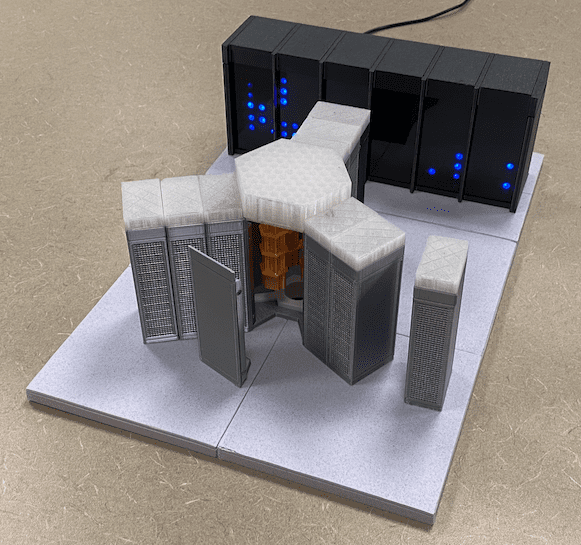

Lo que se inauguró el pasado 14 de octubre en Donostia/San Sebastián no es “un ordenador cuántico más”, sino una infraestructura de última generación: el IBM Quantum System Two.

Para entenderlo bien, imagina esto: mucha gente piensa en un ordenador cuántico como si fuera una “caja” con un chip dentro. Pero en realidad, un sistema cuántico moderno es más parecido a un gran laboratorio de precisión: una instalación compleja que combina tecnología extrema, control electrónico avanzado y ordenadores clásicos trabajando junto con el procesador cuántico.

El IBM Quantum System Two es, precisamente, eso: una plataforma diseñada para la nueva etapa de la computación cuántica. No solo busca tener potencia, sino estar construida con una idea clave: crecer y escalar.

¿Qué significa que sea «modular y escalable»?

Significa que está preparado para evolucionar como lo hacen los grandes centros de computación. En lugar de depender de una única pieza fija, el System Two se diseña como un sistema “por módulos”, de modo que en el futuro pueda incorporar nuevos procesadores cuánticos, y lo más importante: conectar varios entre sí, como si fueran diferentes “cerebros” cuánticos colaborando.

Este cambio de enfoque es crucial.

Durante muchos años, el avance en computación cuántica se explicaba casi siempre con una sola idea: “cuantos más qubits tenga una máquina, mejor”. Pero el sector está cambiando de mentalidad. Los grandes fabricantes (como IBM) están apostando por algo más realista y más útil: la computación cuántica como supercomputación, donde lo importante no es sólo cuántos qubits hay, sino:

- si se pueden controlar bien

- si el sistema puede ejecutar algoritmos complejos de forma estable

- y si se puede ampliar para resolver problemas cada vez más grandes

IBM Quantum System Two no es simplemente un ordenador, sino un paso hacia el “modelo del futuro” de la cuántica: plataformas cuánticas escalables, preparadas para crecer y convertirse en herramientas reales para ciencia e industria.

El corazón del sistema: IBM Quantum Heron (156 qubits)

En el centro del IBM Quantum System Two instalado en Euskadi se encuentra su pieza más importante: el procesador IBM Quantum Heron, con 156 qubits. Dicho de forma sencilla: es el “motor” cuántico del sistema, el lugar donde ocurre el cálculo cuántico.

¿Qué es un qubit y por qué importa?

Si nunca has oído hablar de un qubit, quédate con esta idea:

- Un ordenador normal trabaja con bits, que solo pueden valer 0 o 1.

- Un ordenador cuántico trabaja con qubits, que pueden comportarse como si estuvieran en varios estados a la vez (esto se llama superposición).

Gracias a eso, un sistema cuántico puede explorar ciertas posibilidades de forma muy eficiente, lo que lo hace especialmente prometedor para problemas complejos como simulación de materiales, química, u optimización.

Entonces… ¿Cuantos más qubits, mejor?

En parte sí… pero aquí viene lo importante: en cuántica no basta con “tener muchos qubits”. Lo verdaderamente difícil es que esos qubits funcionen bien.

Los qubits son extremadamente delicados. Cualquier mínima interferencia del entorno (temperatura, vibraciones, ruido electromagnético…) puede hacer que pierdan su comportamiento cuántico. A ese problema se le llama ruido, y es uno de los grandes enemigos de esta tecnología.

Por eso, cuando IBM destaca “Heron”, no lo hace solo por la cifra de 156 qubits, sino porque representa un salto en tres aspectos clave:

Mayor fidelidad (menos errores)

La fidelidad mide lo bien que se ejecutan las operaciones cuánticas. Si una puerta cuántica debería hacer “X”, pero por ruido hace “X con errores”, el cálculo deja de ser fiable.

Más fidelidad = menos errores = resultados más útiles.

Menor ruido (más control)

El ruido es el “enemigo invisible” del cálculo cuántico. Reducirlo significa poder mantener los qubits en buen estado durante más tiempo y ejecutar algoritmos más largos.

Mayor estabilidad (más coherencia)

La coherencia es el tiempo durante el cual un qubit mantiene su comportamiento cuántico antes de degradarse.

Una buena forma de imaginarlo: Un qubit es como una peonza girando. Si el entorno la “molesta”, pierde estabilidad y deja de girar bien.

Cuanta más coherencia tenga el sistema, más cálculos se pueden realizar sin que el resultado se desmorone.

No solo es potencia, es «calidad cuántica»

Por eso, Heron es importante: porque simboliza la transición hacia una computación cuántica más fiable. En esta nueva etapa, el objetivo no es solo “tener qubits”, sino poder controlarlos con precisión, mantenerlos estables el tiempo suficiente, y ejecutar circuitos más complejos sin que el ruido arruine el resultado.

Heron no es solo un chip con 156 qubits, es uno de los pasos más sólidos hacia el objetivo real de toda esta carrera tecnológica: que los ordenadores cuánticos puedan ser útiles en problemas del mundo real, no únicamente en demostraciones experimentales.

La parte que casi nadie explica: el frío extremo y la ingeniería real

Cuando se habla de computación cuántica, casi siempre se mencionan los qubits, las superposiciones y palabras que suenan futuristas. Pero hay una parte que muchas noticias pasan por alto… y es precisamente la que hace que todo esto sea tan impresionante en la práctica: un ordenador cuántico no es solo un chip; es una obra de ingeniería extrema.

De hecho, el verdadero “milagro” no es fabricar qubits, sino lograr que funcionen sin romperse.

¿Por qué hace falta tanto frío?

El IBM Quantum System Two (como muchos sistemas de IBM) usa una tecnología basada en qubits superconductores. Eso significa que los qubits se comportan de forma adecuada sólo si el sistema se mantiene en un estado físico muy especial: la superconductividad.

¿Y cuándo ocurre eso?

Cuando el entorno está tan frío que casi no existe energía térmica capaz de “agitar” el sistema.

Por eso, estos equipos deben operar a temperaturas extremadamente bajas, cercanas al cero absoluto (la temperatura más baja posible en el universo físico).

Para que te hagas una idea: el cero absoluto es −273,15 °C y estos sistemas trabajan a temperaturas incluso más bajas que las del espacio profundo. Es decir, el procesador cuántico funciona en un entorno más frío que el universo “natural”.

Un qubit es extremadamente frágil

A diferencia de un bit clásico (que puedes guardar en un disco duro, un móvil o un USB), un qubit es delicadísimo.

Cualquier mínima perturbación puede estropearlo:

- una vibración

- una interferencia electromagnética

- un aumento minúsculo de temperatura

- incluso ruido de la electrónica de control

Esto provoca que el qubit pierda su comportamiento cuántico, algo conocido como decoherencia.

Una analogía que funciona muy bien: Un qubit es como intentar mantener una pompa de jabón perfecta en medio de una tormenta. El qubit es esa pompa. El mundo real (temperatura, vibraciones, ruido) es la tormenta.

Por eso el entorno debe estar cuidadosamente controlado.

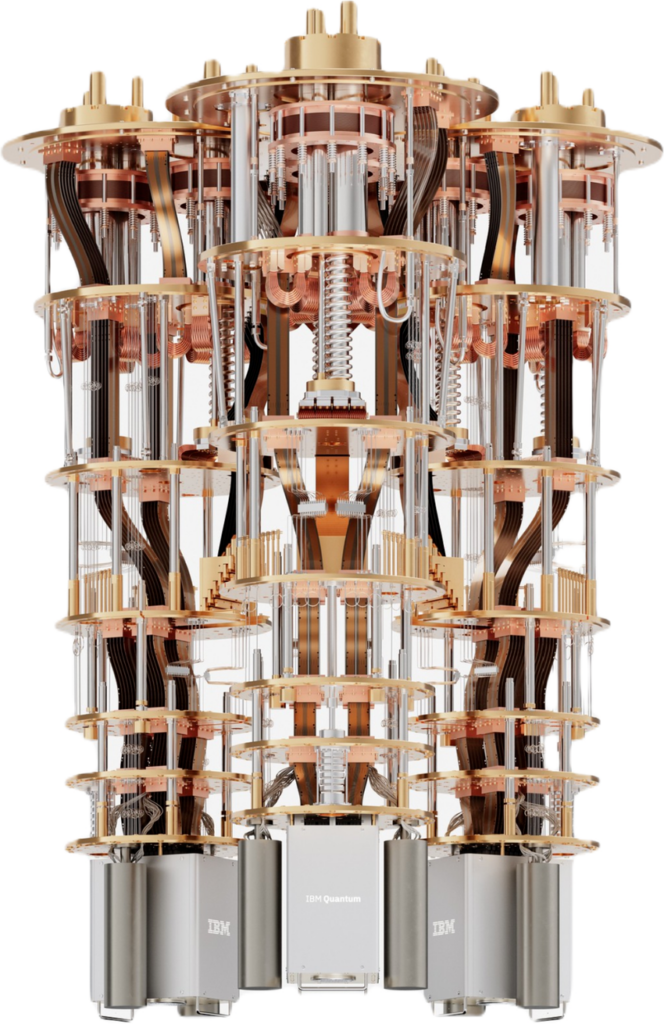

Entonces… ¿Qué es realmente el IBM Quantum System Two?

Aquí viene el concepto importante: el IBM Quantum System Two no es solo un procesador. Es un conjunto enorme de infraestructura que hace posible que ese procesador “viva” en condiciones adecuadas.

Podemos pensar en el sistema como tres capas fundamentales:

Refrigeración criogénica: el “hábitat” del procesador

El chip cuántico está dentro de un sistema llamado criostato (normalmente un refrigerador de dilución), que reduce la temperatura a niveles extremos.

Este sistema enfría el procesador, lo protege del entorno y mantiene condiciones estables durante largos periodos.

Sin esta parte, el chip cuántico no duraría ni un instante funcionando.

Electrónica de control: el “sistema nervioso”

Para operar un qubit necesitas controlarlo con precisión mediante señales eléctricas.

En la práctica esto significa:

- enviar pulsos controlados al procesador

- leer resultados

- corregir desviaciones

- sincronizar operaciones

Esta capa actúa como el “sistema nervioso” del ordenador: es la que traduce instrucciones en operaciones reales sobre los qubits.

Computación clásica integrada: el “copiloto”

Otro error común es imaginar que un ordenador cuántico funciona solo.

En realidad, siempre trabaja con ordenadores clásicos, porque el proceso es híbrido.

Los ordenadores clásicos se encargan de:

- preparar cálculos

- enviar instrucciones

- procesar parte de los resultados

- ajustar parámetros del sistema

- y coordinar la ejecución del algoritmo

El cuántico no sustituye al clásico: lo complementa.

La cuántica no ocurre en una caja, ocurre en un entorno extremo

Esto es lo que convierte al IBM Quantum System Two en algo tan relevante: no sólo han instalado un procesador cuántico, han desplegado una infraestructura completa capaz de sostenerlo y operarlo de forma estable.

Porque la computación cuántica, a diferencia de la clásica, no depende solo del software o del chip… depende de todo el ecosistema físico que permite que la cuántica exista.

Y eso es precisamente lo que se ha desplegado en Donostia: una de las plataformas cuánticas más avanzadas del mundo, no solo por lo que calcula, sino por todo lo que necesita para poder calcular.

¿Por qué es un hito para Europa?

A primera vista, la inauguración de un ordenador cuántico puede parecer “una noticia tecnológica más”. Pero lo que ha ocurrido en Donostia es bastante más profundo: Europa no está asistiendo como espectadora a la revolución cuántica, está empezando a jugar en primera división.

Y esto es lo que convierte al IBM Quantum System Two de Euskadi en un hito estratégico.

Primer IBM Quantum System Two operativo en Europa

La primera razón es directa: es el primer IBM Quantum System Two operativo en Europa.

Esto significa que, por primera vez, el continente tiene acceso en territorio europeo a una plataforma cuántica de esta generación, sin depender exclusivamente de centros situados fuera de Europa.

Y en un momento en el que la tecnología se está convirtiendo en un factor de soberanía y competitividad, esto tiene un valor enorme: no es lo mismo “usar cuántica desde lejos”, que ser parte del mapa donde se construye.

Exclusividad mundial: una infraestructura muy escasa

Este tipo de sistemas no es algo que se “compre y se instale” como un servidor convencional.

Estamos hablando de una tecnología extremadamente compleja, cara y difícil de operar. Por eso existen muy pocas unidades en el mundo.

Que una de ellas esté en Donostia tiene dos implicaciones clave:

- Euskadi se convierte en un nodo internacional dentro de la red cuántica de IBM.

- Europa gana un punto de acceso privilegiado a infraestructura de vanguardia.

En pocas palabras: esto no es solo un avance regional; es posicionamiento global.

No es un prototipo: es infraestructura estratégica

Aquí viene la idea más importante: lo que se ha inaugurado no es un experimento, es una infraestructura estratégica.

Es decir, no se trata de un “prototipo de laboratorio” para hacer demostraciones científicas puntuales. Se trata de un centro orientado a generar impacto real a medio y largo plazo, con cuatro pilares claros:

- Investigación puntera: generar nuevo conocimiento y algoritmos cuánticos.

- Formación avanzada: crear especialistas en una tecnología que será crítica.

- Transferencia industrial: llevar soluciones cuánticas al mundo empresarial.

- Construcción de ecosistema: atraer talento, proyectos, startups y colaboración internacional.

Esta combinación es lo que convierte la inauguración en algo más que un evento: es una apuesta de país y de continente.

Europa no quiere quedarse fuera

Durante años, la carrera cuántica ha estado dominada por grandes potencias tecnológicas. Por eso, que IBM despliegue esta infraestructura en Europa no solo es una cuestión científica; también es una señal geopolítica y económica.

La computación cuántica será clave en energía, industria, defensa, IA y biomedicina. Quien domine su infraestructura dominará parte del futuro tecnológico.

Europa no solo quiere observar la revolución cuántica. Quiere posicionarse dentro… y empezar a construir capacidades propias.

Del “futuro” a la utilidad: el mensaje más importante de IBM

Si tuviéramos que quedarnos con una sola idea de la noticia oficial de IBM, sería esta: el sistema permite ejecutar algoritmos a escala de utilidad (utility-scale).

Puede sonar a frase de marketing, pero en realidad es un mensaje muy potente, porque indica un cambio de etapa en computación cuántica.

Durante años, la cuántica se ha contado como “tecnología del futuro”: prototipos, experimentos, demostraciones espectaculares… pero todavía lejos de resolver problemas reales de forma práctica.

Sin embargo, cuando IBM habla de utility-scale, está diciendo otra cosa: “Estamos empezando a llegar a un punto en el que estas máquinas ya pueden ser útiles, aunque sea en ámbitos concretos.”

¿Qué significa exactamente “utility-scale”?

La expresión utility-scale se refiere a una idea muy sencilla: un ordenador cuántico empieza a ser útil cuando puede ejecutar algoritmos reales con suficiente complejidad como para aportar valor.

No significa necesariamente “ser más rápido que un superordenador clásico en todo”. Significa algo más realista y más importante: que ya puede ejecutar circuitos suficientemente grandes, con una calidad suficiente, como para empezar a abordar problemas que no se pueden simular fácilmente con ordenadores clásicos.

¿Por qué esto es tan importante?

Porque los ordenadores clásicos tienen una limitación brutal cuando intentan simular sistemas cuánticos.

Y aquí ocurre una paradoja fascinante: Para simular un sistema cuántico complejo con un ordenador clásico, necesitas una cantidad de memoria y cálculo que crece de forma explosiva. La complejidad cuántica se dispara tan rápido que lo clásico se ahoga.

Por eso, cuando IBM afirma que su sistema se acerca a la utilidad, está diciendo que ya pueden ejecutar ciertos circuitos que empiezan a entrar en una zona donde simularlo clásicamente es prohibitivo o directamente inviable.

Esto es relevante porque marca el umbral entre “hacemos pruebas cuánticas interesantes” y “podemos empezar a resolver tareas con valor científico o industrial”.

Ojo: utilidad no significa «lo cuántico gana en todo»

IBM no está afirmando que el sistema sea superior a lo clásico para cualquier problema.

Lo que viene a decir es que para ciertos tipos de tareas, en ciertas familias de circuitos, y bajo condiciones específicas, la cuántica empieza a ser competitiva.

Es decir, la computación cuántica no reemplaza a la clásica, sino que empieza a convertirse en una herramienta complementaria que aporta ventajas en problemas concretos.

El cambio psicológico y tecnológico

Hasta ahora, la cuántica se presentaba como promesa. Con utility-scale, IBM está posicionando esta inauguración como parte del camino hacia un objetivo tangible: construir sistemas cuánticos capaces de aportar valor real antes de que llegue la corrección total de errores a gran escala.

Dicho de otra manera: no se espera al ordenador cuántico perfecto. Se empieza a crear utilidad con los sistemas que ya existen, mejorándolos paso a paso.

¿Para qué servirá? (Aplicaciones con impacto real)

Una de las cosas más interesantes de esta inauguración es que el objetivo no es solo tener un ordenador cuántico “para investigar”, sino convertirlo en una herramienta con impacto directo en ciencia e industria.

Esto es importante porque la computación cuántica no es una tecnología para hacer de todo mejor. Su valor aparece sobre todo en problemas muy concretos: aquellos donde hay que explorar muchísimas posibilidades o simular sistemas que, por naturaleza, ya son cuánticos.

Veamos los principales ámbitos donde se espera impacto.

Ciencia de materiales (y química avanzada)

Este es, probablemente, el campo donde la computación cuántica encaja de forma más natural.

¿Por qué?

Porque los materiales y las moléculas se comportan según las leyes cuánticas. Y simular esos comportamientos con precisión en un ordenador clásico es extremadamente difícil cuando el sistema se complica.

Aquí el impacto puede ser enorme:

- diseño y simulación de nuevos materiales con propiedades específicas (más resistentes, más ligeros, más conductores…)

- avance en química computacional, prediciendo cómo se comportan las moléculas

- estudio de propiedades físicas complejas difíciles de modelar clásicamente

Imagina que quieres diseñar un nuevo material para hacer baterías que carguen más rápido y duren más. Antes de fabricar nada, necesitas entender qué combinaciones de estructura y química podrían funcionar. Eso puede requerir simular procesos que, a gran escala, son prohibitivos con computación clásica.

Optimización industrial (logística, planificación y recursos)

Este es el “campo estrella” para que el público general entienda la utilidad de la cuántica.

Muchos problemas industriales son del tipo: “Tengo miles o millones de combinaciones posibles… ¿cuál es la mejor?”

Esto ocurre constantemente en empresas y administraciones:

- diseñar rutas de reparto

- decidir asignación de recursos

- planificar turnos y producción

- optimizar cadenas de suministro

- minimizar costes en logística

Estos problemas suelen ser combinatorios: no es que sean imposibles, es que el número de opciones crece tan rápido que probarlas todas no es viable.

Si una empresa tiene 200 repartos y 30 camiones, hay millones de rutas posibles. Encontrar “la mejor” (rápida, barata y eficiente) puede ser un quebradero de cabeza incluso con supercomputadores.

Aquí la computación cuántica puede aportar nuevas estrategias de búsqueda, algoritmos de optimización híbridos y soluciones aproximadas buenas en menos tiempo.

Biomedicina (simulación biomédica y diseño de fármacos)

La biomedicina es uno de los terrenos donde más se está hablando de futuro cuántico… y no es casualidad.

Los procesos biológicos y químicos detrás de un medicamento implican interacciones moleculares muy complejas. Simular esas interacciones con precisión es uno de los desafíos de la ciencia moderna.

La computación cuántica podría ayudar a modelar con mayor precisión cómo interactúan moléculas, comprender procesos químicos relevantes en medicamentos y acelerar fases del descubrimiento de fármacos (especialmente en simulación).

Cuando una molécula “encaja” en una proteína (como una llave en una cerradura), el resultado puede ser un tratamiento o un fracaso. Poder simular mejor ese encaje permite descartar opciones antes y ahorrar años de desarrollo.

Inteligencia Artificial (y Quantum Machine Learning)

La relación entre cuántica e IA es uno de los terrenos más apasionantes… y donde más expectativas se están generando.

El objetivo no es que “un ordenador cuántico haga IA” directamente como lo hace una GPU. Lo interesante es que, para ciertos tipos de tareas, se están investigando enfoques donde lo cuántico podría acelerar partes del entrenamiento o la optimización, generar representaciones nuevas de datos y mejorar ciertos procesos matemáticos internos (por ejemplo, en modelos probabilísticos o kernels).

Como línea estratégica principal se encuentra la mejora de algoritmos de IA y la investigación en Quantum Machine Learning, donde Euskadi ya está apostando fuerte.

QML todavía está en una etapa muy teórica. Pero tener infraestructura real instalada acelera algo esencial: pasar de teoría a experimentación, probar algoritmos en hardware, y descubrir qué ideas realmente funcionan.

La clave común: simulación + búsqueda combinatoria

Esta lista a veces suena “genérica” en medios, y es verdad que muchos artículos repiten siempre los mismos sectores. Pero hay un punto común real que da coherencia a todo: todos estos casos dependen de simulaciones complejas o búsquedas combinatorias, donde lo clásico se vuelve demasiado costoso.

Eso es lo que conecta materiales, industria, biomedicina e IA: o bien estás simulando sistemas naturales cuánticos, o bien estás explorando miles/millones de alternativas y necesitas encontrar las mejores.

BasQ y el ecosistema: la clave no es la máquina, es la estrategia

Una inauguración tecnológica puede quedarse en una foto institucional… o puede marcar el inicio de un cambio real. Y aquí es donde esta noticia se vuelve especialmente interesante: lo que se está construyendo en Euskadi no es solo un ordenador cuántico, es un ecosistema cuántico.

El despliegue del IBM Quantum System Two se enmarca dentro de BasQ – Basque Quantum, una iniciativa impulsada por el Gobierno Vasco desde 2023 y conectada con el programa IKUR 2030, cuyo objetivo es posicionar Euskadi como un polo internacional en tecnologías cuánticas.

Y este matiz lo cambia todo. Euskadi no está apostando por “comprar una máquina”. Está apostando por construir un polo cuántico integral, con visión a largo plazo.

¿Qué significa construir un «polo cuántico»?

Significa entender que la computación cuántica no despega solo con hardware. Para que una región lidere esta revolución necesita algo más difícil (y mucho más importante):

- personas

- proyectos

- conocimiento

- empresas

- colaboración internacional

- y casos reales donde la tecnología se aplique y genere valor

La máquina es el inicio… pero el éxito depende de lo que se construya alrededor.

Los pilares de BasQ: del laboratorio a la industria

Según la estrategia que se comunica desde las fuentes oficiales, BasQ persigue desarrollar un ecosistema que incluya:

- Investigación científica y colaboración internacional para crear nuevo conocimiento y atraer proyectos de alto nivel

- Programas de formación avanzada porque sin especialistas no hay computación cuántica (ni académica ni empresarial)

- Atracción de talento uno de los grandes cuellos de botella globales: faltan perfiles cuánticos

- Innovación industrial y apoyo al tejido empresarial para que la cuántica no se quede en papers, sino que se traduzca en aplicaciones

Este último punto es esencial: las tecnologías cuánticas sólo se consolidarán si conectan con necesidades reales de industria, energía, biomedicina o IA.

El verdadero impacto: crear masa crítica

En este tipo de apuestas, el hardware es solo la punta del iceberg. El verdadero cambio ocurre cuando una región consigue generar masa crítica, es decir:

- suficientes investigadores trabajando en el tema

- suficientes proyectos activos y financiados

- startups especializadas creciendo alrededor del centro

- empresas tradicionales explorando casos de uso

- y colaboración continua entre universidad + industria + instituciones

Cuando eso ocurre, ya no hablamos de un “centro” aislado, sino de un núcleo que transforma la región.

¿Qué significa esto para la computación cuántica en España?

Este punto es, probablemente, el más inspirador de toda la noticia. Porque más allá de los qubits, los procesadores y la ingeniería extrema, la inauguración del IBM Quantum System Two en Donostia tiene un mensaje claro: España empieza a aparecer en el mapa global de la computación cuántica.

Hasta ahora, las grandes infraestructuras cuánticas de vanguardia se concentraban en unos pocos países y centros tecnológicos. España ha tenido talento científico, investigación y participación en proyectos europeos, sí… pero rara vez aparecía como un lugar donde se instala hardware cuántico puntero y se construyen centros estratégicos alrededor de él.

Con esta inauguración, eso cambia.

De «usuarios» de tecnología a protagonistas del ecosistema

Hay un salto cualitativo muy importante entre dos posiciones:

Usar computación cuántica como un recurso remoto (acceder a máquinas fuera) o convertirse en un nodo internacional donde se investiga, se forma talento y se desarrollan aplicaciones

Lo relevante aquí es que Euskadi (y por extensión España) no queda solo como consumidor de tecnología.

Se sitúa como un punto europeo capaz de impulsar investigación cuántica real, atraer colaboración internacional, conectar ciencia con industria y acelerar la transferencia tecnológica.

En pocas palabras: se pasa de estar “en la conversación” a estar en el tablero.

El posible efecto dominó: lo que puede venir después

La llegada de una infraestructura como esta no solo tiene impacto técnico. Tiene algo aún más valioso: capacidad de atracción.

Cuando una región dispone de tecnología puntera, ocurre un fenómeno casi inevitable: se convierte en un “imán” para proyectos y talento. Y esto puede desencadenar un efecto dominó muy potente:

- Atracción de empresas deep-tech startups y compañías especializadas en cuántica, IA o hardware avanzado

- Programas académicos y formación especializada másteres, doctorados, escuelas técnicas y perfiles híbridos (física + informática + matemáticas)

- Colaboración con centros internacionales proyectos conjuntos, estancias de investigación y participación en redes globales

- Aumento de inversión y financiación estratégica tanto pública como privada, impulsada por el posicionamiento y la oportunidad económica

Si todo esto se consolida, esta inauguración podría ser recordada en el futuro como el momento en el que España empezó a entrar en la cuántica de forma estructural, no solo como investigación aislada.

Conclusión

La inauguración del IBM Quantum System Two en Donostia/San Sebastián representa mucho más que una noticia tecnológica: es un hito europeo, una señal clara de infraestructura estratégica y un paso real hacia una computación cuántica cada vez más útil y aplicable.

Por un lado, estamos ante un avance técnico enorme: un procesador puntero como Heron (156 qubits) dentro de una arquitectura modular diseñada para escalar, sostenida por una ingeniería extrema donde el frío, el control electrónico y la computación híbrida hacen posible lo que, hace apenas unas décadas, parecía ciencia ficción.

Pero lo más importante va más allá del hardware.

Este proyecto confirma que la carrera cuántica ya no se basa solo en publicar investigaciones o en anunciar prototipos. Ahora la clave está en algo mucho más decisivo: construir ecosistemas, atraer talento, generar conocimiento y conectar esa tecnología con problemas reales en ciencia e industria.

En ese sentido, el verdadero valor del IBM Quantum System Two no se medirá únicamente en qubits o en titulares, sino en lo que permita crear a su alrededor durante los próximos años: colaboración internacional, formación avanzada, innovación empresarial y casos de uso con impacto.

Y si este ecosistema crece como se espera, lo ocurrido en Euskadi puede recordarse como el momento en el que Europa (y España) dejaron de mirar la computación cuántica desde fuera… para empezar a construirla desde dentro.